用於工業影像處理的深度學習視覺系統

系統架構與組成元件

深度學習視覺系統現已成為工業影像處理的核心技術之一。無論是精準的瑕疵檢測、智慧化的品質控管,或是自動化決策流程,皆能在傳統影像處理方法無法應對的情境下發揮關鍵作用。本文將說明深度學習視覺系統的功能架構,並介紹確保穩定運作所需的關鍵組成元件。

最後更新: 2025/12/02

深度學習視覺系統的架構設計

深度學習視覺系統自設計之初即針對神經網路最佳化,仰賴 GPU 為核心的運算能力、優化的開發框架,以及端對端的學習模式。這樣的架構帶來高度彈性,但同時也對系統資源有較高需求。

目標:從影像擷取到決策的端對端 AI 整合

深度學習視覺系統的主要目標,是將人工智慧無縫整合至整個流程中。從:

相機擷取原始影像資料

即時處理影像資料

到 AI 模型自動化決策

所有元件皆針對深度學習進行最佳化。如此可形成一個封閉式系統,為高要求的工業應用提供精準、可重現且具擴充性的成果。

深度學習視覺流程:從影像擷取到 AI 支援的決策

系統各元件之間的良好協同運作,是深度學習視覺系統效能的關鍵。典型的深度學習視覺系統工作流程,依序包含以下幾個步驟:

1.影像擷取:機器視覺相機擷取原始影像,並提供高品質的影像資料。

2.影像傳輸:影像擷取卡將影像資料高效且無損地傳送至處理硬體。

3.預處理:透過 pylon 軟體或相機內建功能進行影像優化(例如降噪或去拜耳處理)。深度學習軟體則接手進行資料的控制、設定與分析,並使用 AI 模型進行處理。

4.AI 推論:CNN 模型分析影像並做出決策(例如瑕疵檢測)。

5.結果傳輸:分析結果會傳送至控制器或上層系統。

各模組間透過介面與整合解決方案順暢溝通,亦可輕鬆整合至現有生產環境。此流程可確保在工業應用中實現快速、穩定且可重現的影像分析結果。

深度學習視覺系統的硬體與軟體組成元件

深度學習視覺系統由多個技術上相互協調的組件所構成。每個元件在整體系統中皆負責特定任務,並對系統效能與穩定性產生關鍵影響。

深度學習視覺硬體

影像處理硬體是深度學習視覺系統的資料運算核心。硬體的選擇取決於處理速度、系統成本及可擴展性的需求。根據應用情境的不同,會採用各種不同的平台。

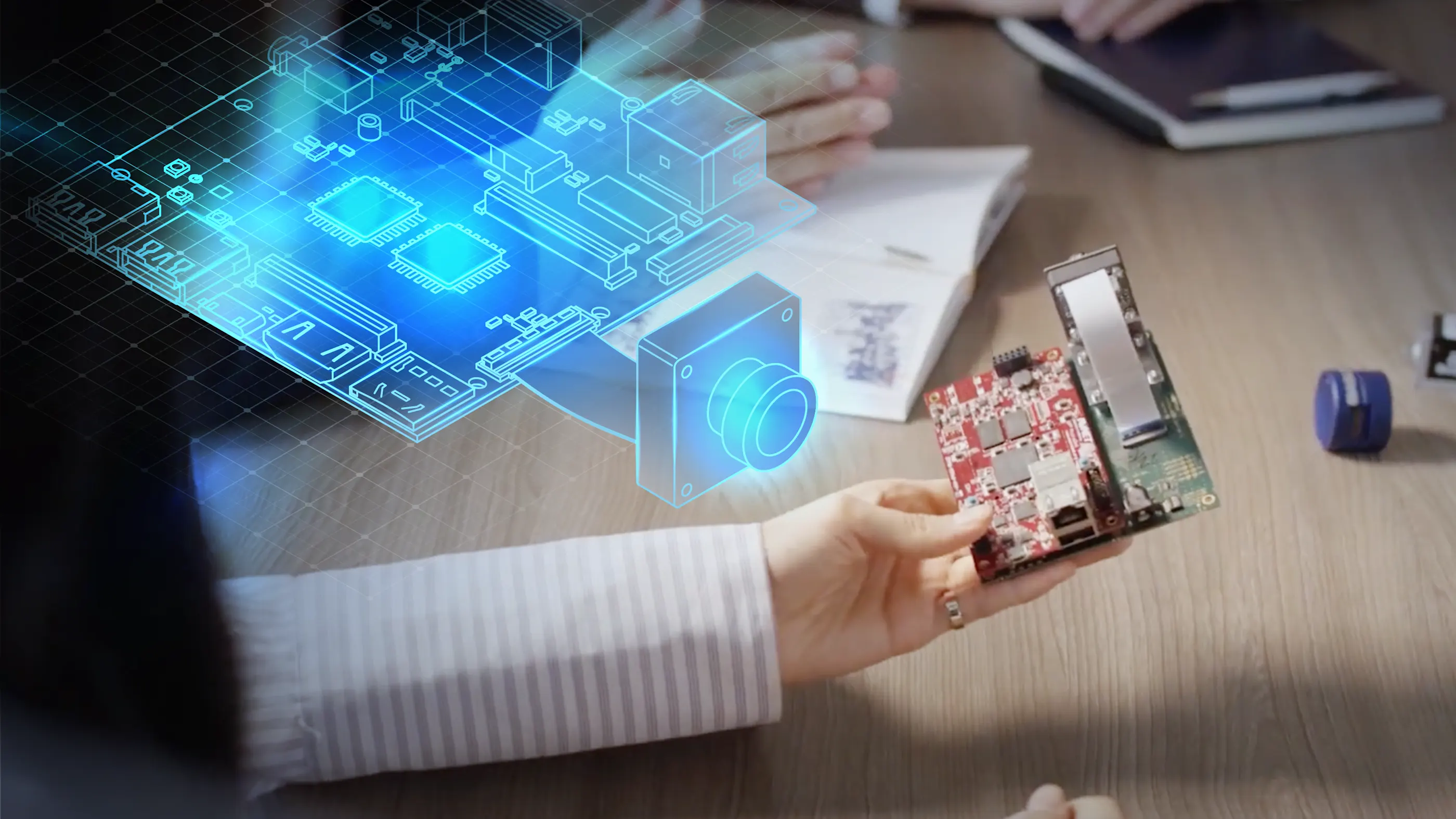

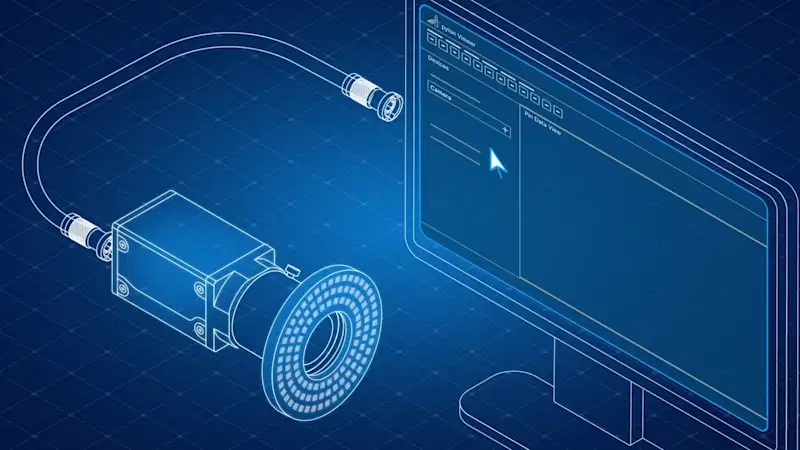

機器視覺相機

機器視覺相機是整個系統的核心元件,負責擷取後續由 AI 模型處理的影像資料。高品質的影像對於獲得精準的推論結果至關重要。Basler ace、Basler ace 2、Basler dart 以及 Basler racer 等工業相機系列具備以下特點:

高解析度與優異影像品質

支援主流介面,如 GigE、USB 3.0 與 CoaXPress

內建影像前處理功能(例如去拜耳處理、銳化、降噪)

可重現的影像結果,適用於可靠的深度學習應用

影像擷取卡與影像資料管理

在需要高資料吞吐量或即時性要求的應用中,影像擷取卡是不可或缺的元件。影像擷取卡可直接從相機擷取影像資料,並傳送至系統進行後續處理。特別是在搭配 FPGA 處理器使用時,能實現零延遲、穩定且高速的影像擷取與處理能力。

深度學習軟體與工具

軟體是硬體與 AI 模型之間的橋樑,負責相機的整合、設定與控制,同時也支援深度學習模型的訓練與執行。

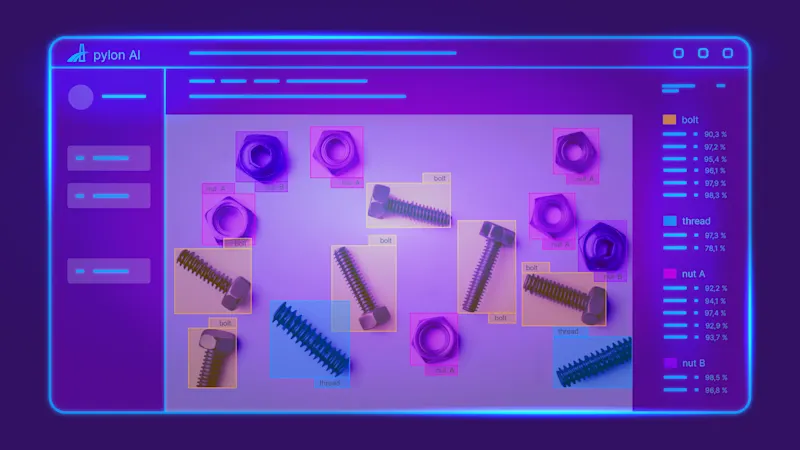

pylon AI

pylon AI 是一個功能強大的平台,專為在工業影像處理流程中高效整合與執行卷積神經網路(CNN)而設計。pylon AI 可讓使用者將自有 AI 模型直接整合至目標硬體,並進行最佳化與效能評估。

影像處理專用 pylon vTools

結合 pylon vTools,可提供多種可立即使用、針對應用設計的影像處理功能,例如物件辨識、OCR、影像分割與分類等,無需具備深入的程式設計知識。vTools 基於經典演算法與人工智慧技術所開發。

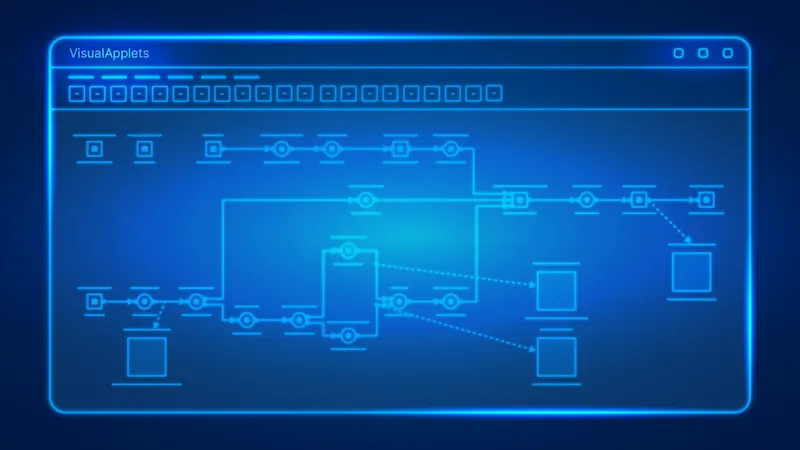

VisualApplets:用於 FPGA 編程的圖形化工具

對於以 FPGA 為基礎的系統,VisualApplets 提供直覺化的圖形開發環境,使影像前處理步驟可在硬體層級彈性實作。此一組合可在整個深度學習視覺系統中確保最高的彈性、可擴充性與精準度。透過 FPGA 預處理,例如可在實際進行推論(Inference)之前,僅選取相關影像區域(Region of Interest, ROI,感興趣區域)進行後續處理,從而有針對性地降低並優化龐大的資料量。

優勢: 降低運算負載、在相同硬體條件下提升推論吞吐量,並聚焦關鍵資訊,進一步提高整體準確度。

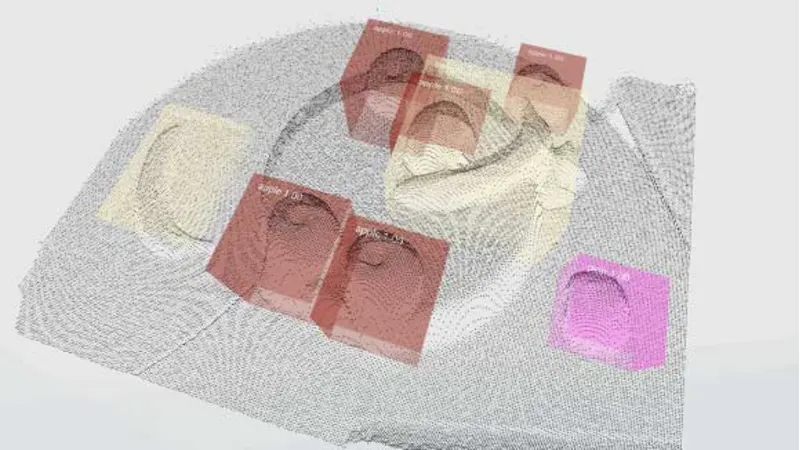

透過 AI 模型進行推論

在推論階段,通常由卷積神經網路(CNN)負責分析輸入的影像資料。該模型會透過多層處理流程,對機器視覺相機擷取的影像進行分析,以萃取出形狀、邊緣或紋理等相關特徵。接著根據應用需求,執行分類、分割或物件辨識等任務。

結合 pylon AI 與 pylon vTools,此流程可自動化並即時執行:影像資料會直接傳送至 AI 模型進行處理,模型便能即時辨識瑕疵元件、讀取產品上的文字(OCR),或在影像中定位特定物件等。

推論結果可立即提供後續流程使用,如分選、品質檢測或製程優化。此流程可無縫整合至深度學習視覺系統中,實現快速、精準且可重現的決策。

模型品質在很大程度上取決於訓練資料的品質,以及其對所使用硬體的最佳化程度。因此,在影像擷取階段獲得最高品質的影像,不僅對訓練 AI 至關重要,更是其基礎。訓練時影像資料品質越高,AI 分析的結果與衍生決策的準確性與可靠性也就越高。

已預先訓練的模型亦可透過 pylon AI 輕鬆整合並持續優化。

系統整合與介面

決定深度學習視覺系統效能的關鍵因素

在工業影像處理中成功導入深度學習視覺系統,極大程度取決於完善的系統整合與正確介面的選擇。AI 模型與硬體間的高效通訊,以及無縫整合至生產流程,是實現系統效能的關鍵。

軟硬體之間的無縫整合

pylon 軟體提供經過認證的驅動程式與高效能介面,確保 AI 推論與相機硬體之間的直接且穩定的通訊。這些介面包括:GigE Vision– 適用於靈活的網路解決方案、USB3 Vision– 簡易連接的理想選擇、CoaXPress– 適用於對頻寬與即時性要求極高的應用

pylon AI 則提供強大的解決方案,能將卷積神經網路(CNN)直接整合至既有的 pylon 影像處理流程中,實現穩定且高效的資料處理。

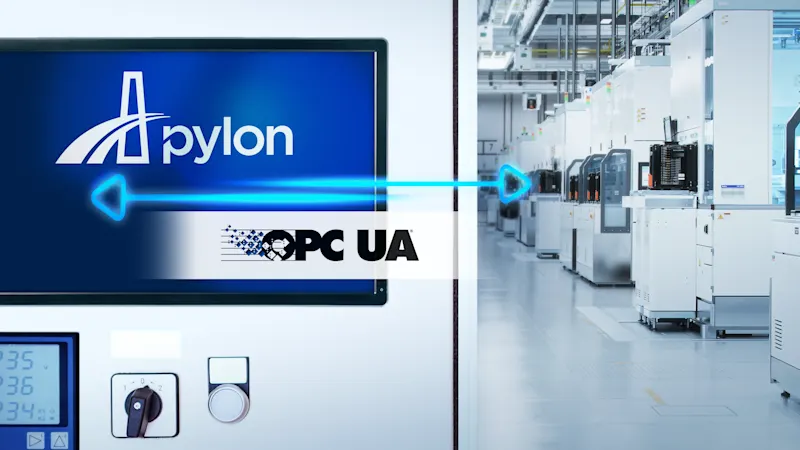

工業級通訊整合

支援 OPC UA 是連接至上位控制系統(如 PLC 或 MES 系統)的關鍵。它可將 AI 推論結果直接傳送至控制系統。OPC UA 為一平台與製造商中立的標準,能在機台之間實現簡便且一致的資料交換。搭配 OPC UA vTool,您可將影像處理流程中的結果直接發佈至 OPC UA Server,實現無縫的資料整合。

配方代碼產生器也能促進 AI 模型快速適應不斷變化的產品變型,進而提高生產的靈活性。有關 pylon Viewer 中 Recipe Code Generator 的詳細資訊,也可在 Basler 產品文件中找到。此外,Recipe Code Generator(參數組合代碼產生器) 可協助快速調整 AI 模型以因應產品變異,進而提升生產靈活性。關於 pylon Viewer 中 Recipe Code Generator 的詳細資訊,可參閱 Basler 產品使用手冊 。

彈性架構:邊緣運算與雲端整合

深度學習視覺系統的需求因應用情境而異,因此彈性的系統架構變得至關重要:

用於分散式應用的邊緣運算

針對具低延遲需求、行動性或分散式架構的應用,可透過嵌入式視覺技術直接在邊緣設備上執行 AI 模型。像是 NVIDIA® Jetson™ 等平台可在裝置端即時執行 AI 模型,實現最大自主性、最小延遲,並降低對網路連線的依賴。

可擴充的雲端整合

若應用需要處理大量資料、進行分散式訓練,或集中管理多套系統,我們亦支援與主流雲端平台整合,例如:Amazon Web Services (AWS)、Microsoft Azure 和 Google Cloud Platform。此類整合可為複雜的深度學習流程提供所需的彈性與可擴展性。

這類標準化且彈性的系統整合方式,確保影像資料可被快速、穩定且可重現地分析,並可將深度學習視覺系統整合至分散式生產環境中,使 AI 支援的分析與決策可直接在影像資料產生的第一時間即完成。這對於在複雜、多據點的生產網路中實現高效率的品質管控、瑕疵檢測與流程優化至關重要。

簡便的安裝與可靠的系統整合是長期成功的關鍵,能協助有效應對各類複雜任務。

一套功能完善的深度學習視覺系統,通常包含高品質的機器視覺相機、高效能的影像擷取卡、合適的影像處理硬體、專業的深度學習軟體,以及經過最佳化的 AI 模型。穩定且高效能的介面可確保系統整合流程順暢無礙。我們透過完整的產品與服務,為視覺工程師及所有致力於 AI 解決方案開發的應用人員,提供實現高階工業影像處理專案的堅實基礎—從原型開發一路到量產導入。