3D-Bildverarbeitung

Roboter mit dreidimensionaler Wahrnehmung

Roboter, die Waren schnell und präzise greifen, waren lange schwer umzusetzen. Doch dank moderner 3D-Bildverarbeitung können Roboter räumlich sehen und fast menschlich interagieren. Diese Technologie revolutioniert die Bildverarbeitung und gewinnt zunehmend an Bedeutung.

Wie Fortschritte in der Vision Technologie die Robotik verändern

Entdecken Sie die Welt der bildgeführten Robotik. Unser Webinar zeigt , welche 2D- und 3D-Vision-Technologien für Ihre Anwendungen ideal sind. Wir beleuchten typische Aufgaben in Materialhandhabung, Logistik, Prozess- und Qualitätskontrolle und mehr. Erfahren Sie, welche Kriterien Sie bei der Auswahl Ihrer Vision Komponenten beachten sollten.

Robotik-Webinar ansehenVerschiedene 3D-Verfahren und ihre Einsatzgebiete

Dank 3D-Bildverarbeitung eröffnen sich in der Robotik, der Fabrik- und Logistikautomatisierung völlig neue Möglichkeiten. Diese Technologie ist besonders relevant, wenn Volumen, Formen oder die 3D-Position und Orientierung von Objekten präzise erfasst werden müssen. Was aber ist die Technik hinter der Erzeugung dreidimensionaler Bilder? Zurzeit dominieren vier Verfahren diesen Bereich: Time-of-Flight, Lasertriangulation, Stereo Vision und strukturiertes Licht.

Stereo Vision und strukturiertes Licht

Stereo Vision arbeitet ähnlich wie das menschliche Augenpaar. Zwei 2D-Kameras nehmen zwei Bilder eines Objekts aus zwei verschiedenen Positionen auf und berechnen die 3D-Tiefeninformation mit Hilfe des Triangulationsprinzips. Schwierig wird dies bei homogenen Flächen und schlechten Lichtverhältnissen. In diesen Fällen können nicht genügend übereinstimmende Fakten in den beiden Bildern gefunden werden, um daraus dreidimensionale Bilder zu errechnen. Hier kommt strukturiertes Licht ins Spiel, das durch das Hinzufügen vordefinierter Muster die Bildanalyse erleichtert.

Einsatzgebiet

Stereo Vision bietet besonders im Nahbereich hohe Präzision. Zur Erreichung dieser Genauigkeit sind jedoch zusätzliche Referenzmarken, zufällige Muster oder Lichtpattern erforderlich, die durch eine strukturierte Lichtquelle ins Bild integriert werden. Diese Technologie eignet sich hervorragend für die Koordinatenmesstechnik und die 3D-Vermessung von Arbeitsräumen. Im Produktionsumfeld wird sie meist nur dann verwendet, wenn eine hohe Prozessorlast und höhere Systemkosten akzeptiert werden.

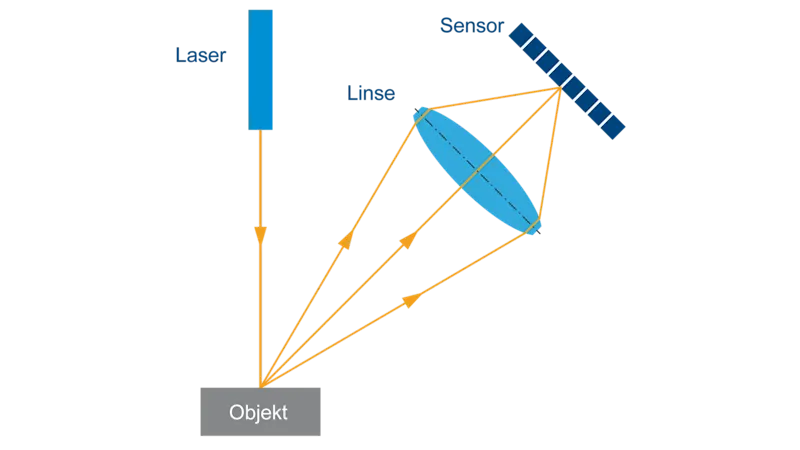

Lasertriangulation

Die Lasertriangulation nutzt eine 2D-Kamera und eine Laserlichtquelle, um die Entfernung von Objekten zu messen. Der Laser projiziert Linien auf das Objekt, die von der Kamera erfasst werden. Ändert sich die Objektentfernung, verschiebt sich die Position der Laserlinie im Bild, wodurch sich die Entfernung berechnen lässt.

Einsatzgebiet

In der 3D-Bildverarbeitung bietet die Lasertriangulation präzise Ergebnisse, auch bei kontrastarmen Objekten und schwierigen Lichtverhältnissen, dank des strukturierten Lichts. Das Verfahren eignet sich gut für Anwendungen, die hohe Genauigkeit erfordern. Die Lasertriangulation wird häufig in der Qualitätskontrolle, 3D-Vermessung, Elektronikfertigung und Medizintechnik eingesetzt. Allerdings ist es aufgrund des scannenden Verfahrens relativ langsam und eignet sich daher nicht für schnelle Produktionsumfelder.

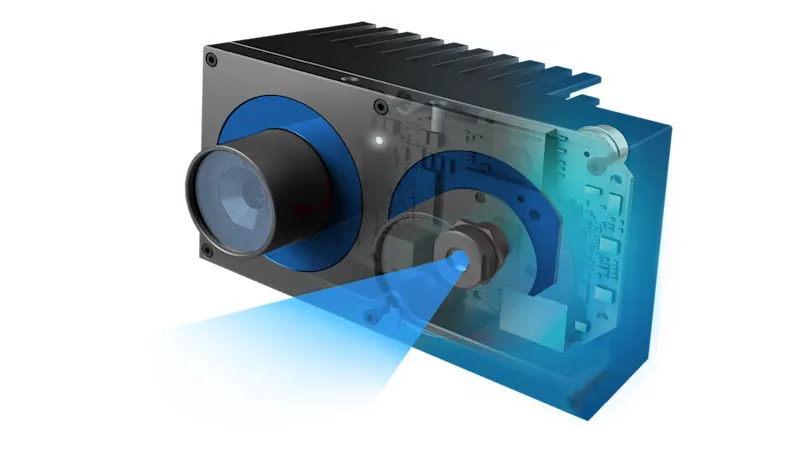

Time-of-Flight (ToF) für präzise Tiefenmessung

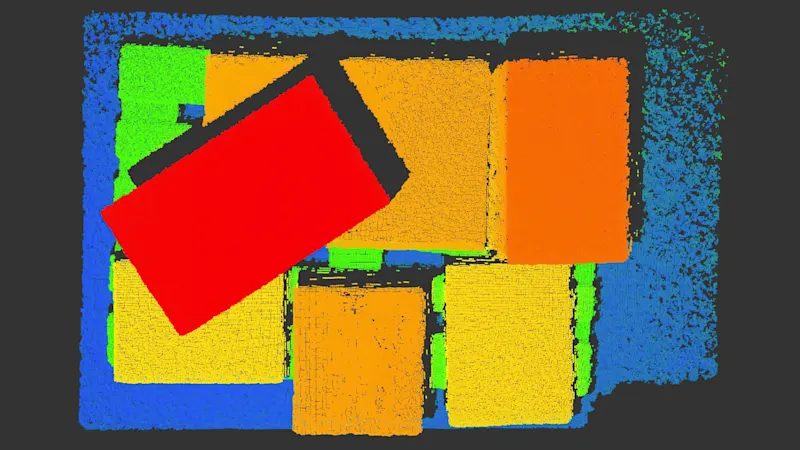

Time-of-Flight (ToF) ist eine effiziente Technologie zur Tiefenmessung und Entfernungsbestimmung. Eine ToF-Kamera liefert für jedes Pixel sowohl den Intensitätswert als auch den Tiefenwert, der die Entfernung zum Objekt angibt. Mit dem ToF-Verfahren können detaillierte Punktwolken in Echtzeit erzeugt werden, während gleichzeitig ein Intensitäts- und Konfidenzbild erstellt wird.

Einsatzgebiet

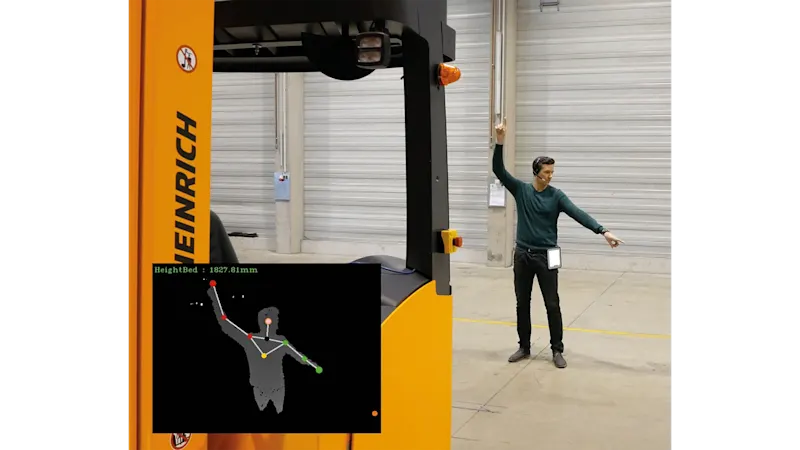

ToF eignet sich hervorragend für Volumenmessungen, Palettieraufgaben, autonome Fahrzeuge und Robotersteuerungen in der Fabrikautomation. Weitere Anwendungen finden sich in der Medizin, etwa bei der Patientenüberwachung und Positionierung.

Welche Technologie eignet sich für meine Anwendung?

Wie bei 2D-Kameras gibt es auch bei 3D-Kameras keine universelle Lösung für alle 3D-Bildverarbeitungs-Aufgaben. Um die optimale Technologie auszuwählen, müssen die Anforderungen der spezifischen Anwendung sorgfältig abgewogen werden.

Entscheidende Faktoren bei der Wahl der 3D-Technologie

Wichtige Fragen bei der Auswahl der passenden Technologie sind: Soll die Position, Form, Orientierung oder das Vorhandensein von Objekten erfasst werden? Welche Genauigkeit wird benötigt? Wie ist die Oberflächenbeschaffenheit des Objekts? Zudem spielen der Arbeitsabstand, die geforderte Geschwindigkeit sowie die Kosten und die Komplexität der angestrebten Lösung eine entscheidende Rolle. Diese Faktoren müssen mit den Möglichkeiten der 3D-Technologie in Einklang gebracht werden, um die beste Wahl zu treffen.

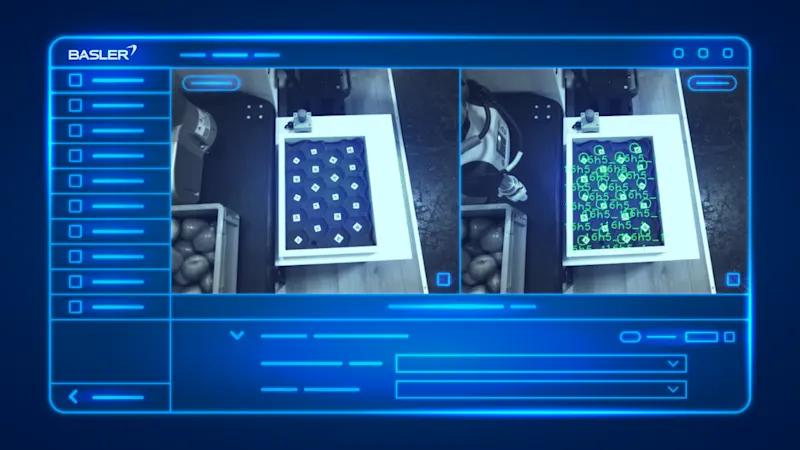

Unsere Produkte für bildgeführte Robotik

Nutzen Sie unser breitgefächertes Portfolio und wählen Sie die passenden Produkt für Ihr Vision System. Unser Vision System Configurator hilft Ihnen Ihr System schnell und einfach zusammenzustellen.